Las redes sociales de Meta han distribuido entre sus usuarios publicidad pagada por esta y otras herramientas utilizadas para crear imágenes de desnudos no consentidas

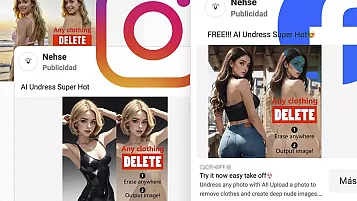

Instagram y Facebook cobran por publicitar entre sus usuarios la misma aplicación de inteligencia artificial que se usó para crear imágenes de menores de edad desnudas en Almendralejo (Badajoz) el pasado septiembre. Las redes sociales de Meta promocionaron al menos 22 anuncios de esta herramienta entre el 24 y el 27 de abril que se distribuyeron en varios países de la UE, incluyendo España, según ha podido comprobar elDiario.es en su Biblioteca de Anuncios.

La app se sirve de una fotografía real de una mujer subida por el usuario, de la que elimina la ropa de la imagen de manera no consentida usando algoritmos generativos. Su empleo con menores de edad provocó una gran alarma social en España cuando un grupo de alumnas de un instituto descubrió que sus compañeros habían creado y compartido por WhatsApp imágenes falsas que las mostraban desnudas.

“Las fotos han pasado por un montón de manos y, aunque sea mentira, que todo el mundo las vea puede hacerles mucho daño. Hay niñas que lo están pasando verdaderamente mal porque se están metiendo con ellas a raíz de esto”, lamentaba la madre de una de las menores afectadas. El caso desató un debate sobre el potencial de esta tecnología y su capacidad para generar violencia contra la mujer cuando se emplea sin restricciones.

A pesar de la controversia, los 16 anuncios diferentes que estuvieron activos a finales de abril para promocionarla no hicieron saltar las alarmas en Meta. Ni de sus filtros automáticos ni en la revisión humana, si es que esta llegó a existir. Meta no bloqueó ninguna de las versiones de la publicidad en ningún momento, tal y como refleja la herramienta que recoge los contenidos que se han promocionado en sus sistemas.

La distribución de los anuncios fue limitada. Las cifras de impacto varían de casi mil en las versiones más distribuidas a unas pocas decenas. Meta no informa de cuánto cobró por esta promoción, unos datos que solo ofrece en la categoría de anuncios políticos. Solo se distribuyeron entre hombres de más de 18 años, asegura la herramienta de transparencia publicitaria de la corporación dirigida por Mark Zuckerberg.

La publicidad se pagó a través de la página de Facebook de “Neshe”, un anunciante que asegura ser una marca de trajes típicos alemanes hechos a mano. Sin embargo, su página web no funciona y su actividad en Facebook se limita a dos publicaciones subidas el pasado septiembre. Tiene un solo me gusta. elDiario.es se ha intentado poner en contacto con los administradores de la página pero no ha obtenido respuesta.

Esta redacción también ha preguntado a Meta por estos anuncios, pero no ha obtenido respuesta al cierre de esta información.

Anuncios del mismo tipo todavía activos

La app del caso de Almendralejo no es ni mucho menos única en su clase. En este momento, de hecho, las redes sociales de Meta tienen anuncios activos que promocionan otras herramientas del mismo estilo para eliminar la ropa de fotografías de mujeres y crear deepfakes.

Según muestra la Biblioteca de Anuncios de Meta, la corporación ha tenido un goteo incesante de este tipo de publicidad en los últimos meses. Algunos de ellos han sido eliminados de sus sistemas por violar su política de anuncios, pero otros contenidos que promocionaban las mismas páginas y las mismas apps no han sido detectados.

Las características de los anunciantes son casi siempre las mismas. Las páginas que los publican apenas acumulan un puñado de publicaciones o me gusta y no suelen tener ningún seguidor. El impacto de sus anuncios varía en función de la cantidad invertida.

Como explicaron varios juristas a elDiario.es, algunas de las consecuencias legales del uso de este herramientas para crear deepfakes no consentidos siguen en el aire. Sería un delito contra el honor y la intimidad, en todo caso, crearlas y compartir con terceros sin el permiso de la persona que aparece en ellos. Sin embargo, no estaría penada su mera creación y almacenamiento.

En el caso de menores, en cambio, todo cambia. La mera posesión se considera delictiva y, de hecho, la Policía ya ha realizado varias detenciones de personas que almacenaban pornografía infantil creada con inteligencia artificial. “Si las imágenes muestran a menores se trata de un delito de pornografía infantil simulada que está prevista en el propio artículo 189 del Código Penal. Basta que sean imágenes realistas para que el delito se consume”, explicó a este medio el abogado Carlos Sánchez Almeida.